Wer schon mal versucht hat, einen KI-Agenten in Produktion zu bringen, kennt das Gefühl: Das Modell läuft wunderbar im Demo, aber dann kommen Sandboxing, Checkpointing, Credential-Management, Retry-Logik bei Containerausfällen — und plötzlich sind drei Monate weg, bevor der erste User irgendetwas davon sieht.

Genau hier setzt Anthropic mit Claude Managed Agents an, seit dem 8. April 2026 in der öffentlichen Beta.

Das Problem, das niemand gerne benennt

Der Aufbau eines produktionstauglichen Agenten ist kein KI-Problem. Es ist ein Infrastrukturproblem.

Ein Agent, der echte Aufgaben erledigt, braucht: eine isolierte Ausführungsumgebung, die sicher bleibt, auch wenn das Modell eigenen Code ausführt. Einen persistenten Zustand, der Containerabstürze überlebt. Einen Credential-Store, der außerhalb der Sandbox liegt, damit ein Prompt-Injection-Angriff nicht sofort an API-Keys kommt. Tracing, damit du weißt, was wann schiefgelaufen ist. Und das alles für Sessions, die nicht Sekunden, sondern Stunden laufen.

Laut Anthropic: “months of infrastructure work before you ship anything users see.” Das ist keine Übertreibung.

Was Managed Agents tatsächlich liefert

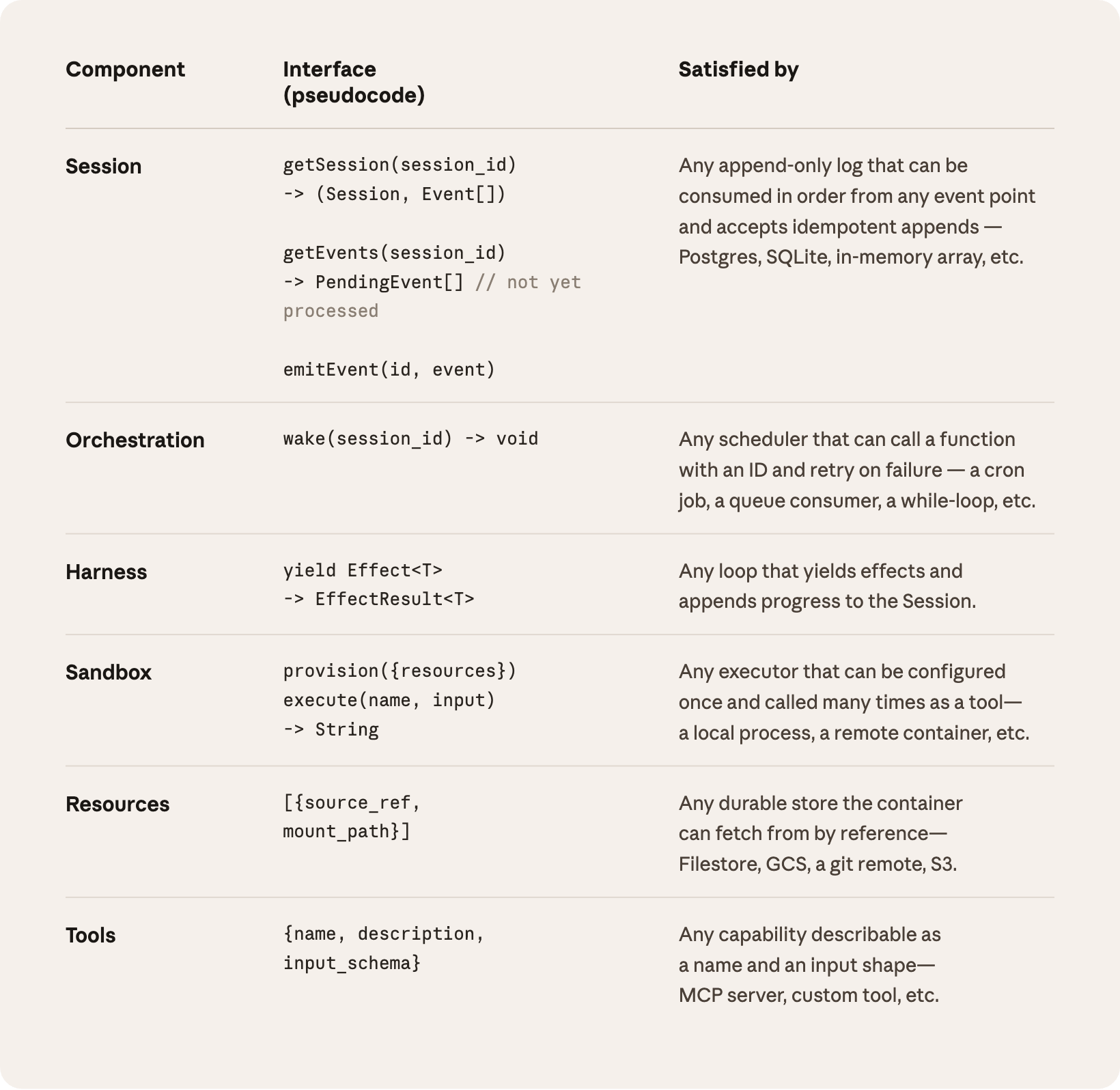

Der Kern ist eine durchdachte Architektur aus drei entkoppelten Komponenten — und die Entkopplung ist der eigentliche Wert.

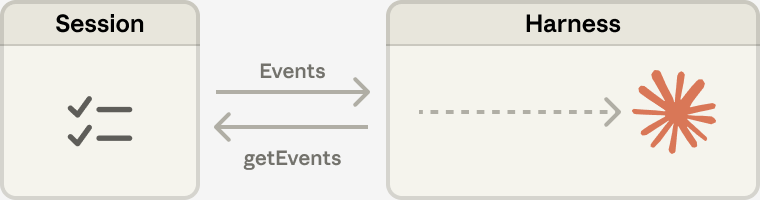

Brain ist Claude selbst plus der Harness — die Orchestrierungslogik, die entscheidet, wann welches Tool aufgerufen wird. Hands sind ephemere Sandbox-Container, in denen der generierte Code läuft. Session ist ein append-only Event Log, der außerhalb aller anderen Komponenten lebt.

Was das in der Praxis bedeutet: Wenn ein Container abstürzt, fängt der Harness das als Tool-Call-Fehler ab und bootet einen neuen. Wenn der Harness selbst crasht, kann eine neue Instanz mit wake(sessionId) den letzten Stand aus dem Session Log wiederherstellen und weitermachen. Kein Zustand geht verloren.

Das ist kein Marketing — das ist ein klassisches Pets-vs-Cattle-Problem, das Anthropic hier sauber gelöst hat. In früheren Architekturen war der Container ein “Pet”: ein Name, eine Geschichte, nicht ersetzbar. Jetzt ist er Cattle: statuslos, austauschbar, skalierbar.

Sicherheit durch Struktur, nicht durch Hoffen

Die Credential-Behandlung ist der Teil, den viele Teams intern schlicht falsch machen. Wenn KI-generierter Code im selben Container läuft wie die API-Keys, die dieser Code aufrufen soll, reicht ein erfolgreicher Prompt-Injection-Angriff, um alle Credentials zu exfiltrieren.

Managed Agents trennt das strukturell: Für Git wird das Access-Token beim Sandbox-Start injiziert und ins lokale Git-Remote gedrrahtet — der Agent kann pushen und pullen, ohne das Token je zu sehen. Für externe Services via MCP liegen OAuth-Tokens in einem separaten Vault; ein Proxy fetcht sie bei Bedarf und macht den eigentlichen API-Call. Der Harness sieht nie ein Credential.

Das ist der Unterschied zwischen “wir haben darüber nachgedacht” und “wir haben es unmöglich gemacht.”

Session als externe Kontextverwaltung

Ein oft unterschätzter Teil: Was passiert, wenn ein Task länger läuft als das Kontextfenster von Claude?

Die übliche Antwort ist Komprimierung — ein Summary wird gespeichert, alte Tokens werden verworfen. Das Problem: Irreversible Entscheidungen darüber, was behalten wird, führen zu Fehlern. Du weißt nicht im Voraus, welche früheren Informationen ein späterer Schritt braucht.

Managed Agents löst das durch das Session Log selbst. Es ist kein interner Zustand des Modells, sondern ein externes Objekt. Claude kann via getEvents() gezielt Abschnitte nachladen — die letzten N Events, alles vor einem bestimmten Zeitpunkt, einen bestimmten Tool-Call und seine Umgebung. Das ist deutlich robuster als jede komprimierte Zusammenfassung.

Wer es schon nutzt — und was dabei rauskommt

Mehrere Unternehmen haben Managed Agents bereits in Produktion:

Notion hat Claude direkt in Workspaces eingebettet — Teams können Coding, Präsentationen und Tabellen delegieren, ohne die App zu verlassen. Rakuten hat in einer Woche pro Deployment spezialisierte Agenten für Produkt, Sales, Marketing und Finance ausgerollt und an Slack und Teams angebunden. Asana baut “AI Teammates”, die innerhalb von Projekten neben Menschen arbeiten — CTO Amritansh Raghav sagt, Managed Agents hat ihnen geholfen, fortgeschrittene Features schneller zu shippen. Sentry hat sein Debugging-Tool Seer mit einem Agenten verbunden, der automatisch Patches schreibt und Pull Requests öffnet: von flagged Bug zu reviewable Fix in einem Flow. Atlassian arbeitet daran, Entwicklern zu ermöglichen, Tasks direkt aus Jira heraus zu delegieren.

Das sind keine Proof-of-Concepts. Das sind Produktionssysteme.

Pricing und was in der Preview bleibt

Die Abrechnung ist verbrauchsbasiert: Standard Claude API-Preise für Tokens, plus $0,08 pro aktiver Session-Hour (Idle-Zeit — also Warten auf User-Input oder Tool-Responses — zählt nicht). Web-Suchen kosten $10 pro 1.000 Anfragen.

Für die meisten Workloads ist das günstiger als eigene Infrastruktur, sobald man den Engineering-Aufwand einrechnet.

Was noch in der Research Preview ist: Multi-Agent-Orchestration (ein Agent spawnt und koordiniert andere), erweiterte Memory-Tools und Self-Evaluation (ein Agent iteriert, bis er ein definiertes Ergebnis erreicht).

Was das für euch bedeutet

Wenn ihr gerade einen Agenten baut oder plant — die Frage ist nicht mehr “können wir das?” Die Frage ist “wollen wir die Infrastruktur selbst besitzen?”

Für Teams, die schnell shippen wollen, ist Managed Agents ein klarer Gewinn. Die Brain/Hands/Session-Entkopplung ist solide durchdacht, die Security-Grenzen sind strukturell, nicht nur konventionell. Und der p50-TTFT (Zeit bis zum ersten Response-Token) ist laut Anthropic durch die Entkopplung um 60% gefallen — p95 sogar um über 90%.

Für Teams mit sehr spezifischen Compliance-Anforderungen oder dem Wunsch, die gesamte Infrastruktur selbst zu kontrollieren: Der “Brain” (Claude und der Harness) läuft weiterhin auf Anthropic-Infrastruktur. Managed Agents unterstützt zwar Verbindungen zu eurem eigenen VPC für die “Hands” — aber das sollte in eurer Vendor-Assessment-Checkliste stehen.

Unsere Einschätzung: Das ist eine der durchdachtesten Infrastruktur-Architekturen, die wir im Agentic-AI-Bereich gesehen haben. Kein Zufallsprodukt, sondern das Ergebnis echter Produktionserfahrung mit Claude Code und internen Agent-Deployments.

Wenn ihr Managed Agents für euren Stack evaluieren wollt oder Unterstützung beim Aufbau sicherer Agentic-Workflows braucht — sprecht uns an. Wir bauen diese Systeme seit dem ersten Tag.